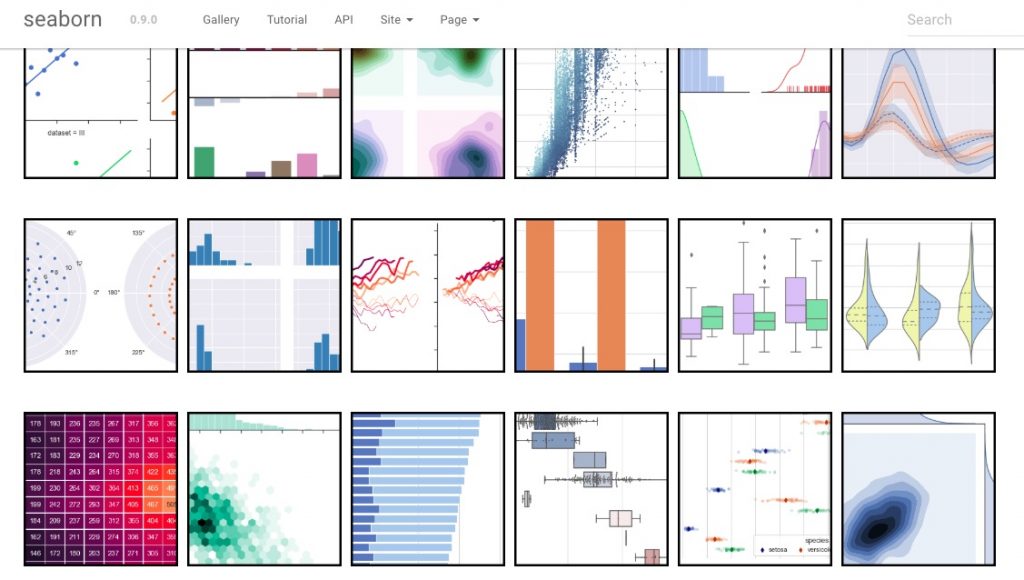

Pythonでデータ処理をする際、グラフで描画と言えばまずはMatplotlibhttps://matplotlib.org/が有名でしょうか。 それ以外にもあまり知られてはいないものの(十分知られているかもですが、、、汗)さらに高度で便利なグラフ描画ライブラリーがありますので紹介します。 seabornhttps://seaborn.pydata.org/index.html#matplotlibをベースに、より多彩で高度なグラフ描画を可能にするライブラリーです。 下記画像の様に非常な多彩で高度なグラフ描画が可能になっています。 Ipyvolumehttps://ipyvolume.readthedocs.io/en/latest/ 3Dのグラフ(動かせます)を描画できるライブラリーです。JupyterNotebook上で import ipyvolume as ipv import numpy as np x, y, z = np.random.random((3, 10000)) ipv.quickscatter(x, y, z, size=1, marker=”sphere”) 上記の様な簡単なコードで複雑な3Dグラフを作成できます。 アニメーショングラフも描画可能です。 Gymhttps://gym.openai.com/envs/#classic_controlグラフ描画とは少々異なりますが、、、機械学習、特に強化学習の検証でよく使用されるCartPole-v1はGymが活用されています。 import gym env = gym.make(‘CartPole-v0’) env.reset() for _ in range(1000): env.render() env.step(env.action_space.sample()) # take a random action 機械学習を勉強した事のある方は見覚えがあるかもしれません。 Pythonは色々なライブラリーが次々とリリースされアップデートされていくのがすごいところですね。canplayの最新音楽トレンド分析は、1月からAI音楽データサイエンスの講義としてもアップグレードします!この様なライブラリーの使用方法もどんどん解説していきますね!